La creación de imágenes de inteligencia artificial (IA) es el proceso mediante el cual los sistemas de IA producen material visual a partir de entradas, con frecuencia en descripciones de texto.

Estos sistemas entienden la entrada y crean visuales asociados utilizando técnicas avanzadas de aprendizaje automático, especialmente en visión por ordenador y aprendizaje profundo. Pero surge la pregunta: ¿Qué es la stable diffusion y cómo se desarrolla en la industria de la imagen de IA?

La difusión estable es un modelo de generación de imágenes basado en IA que avanza significativamente en la industria de la imagen de IA. Crea imágenes detalladas a partir de descripciones de texto utilizando técnicas de aprendizaje profundo y difusión.

A diferencia de sus predecesores, que dependen de la nube, su capacidad para funcionar con hardware de consumo normal supone un paso importante para que la generación avanzada de imágenes de IA sea más accesible y generalizada.

Por su accesibilidad y facilidad de uso, stable diffusion es único en la producción de imágenes de inteligencia artificial. Dado que el modelo está hecho para funcionar con tarjetas gráficas estándar, casi cualquiera puede crear imágenes fácilmente con él.

La plataforma mejora el control creativo al permitir la modificación de múltiples factores. Además, cuenta con el apoyo de una comunidad activa que ofrece orientación y tutoriales exhaustivos. El modelo se publica bajo la licencia Creative ML OpenRAIL-M, lo que favorece la flexibilidad en el uso y la modificación del software.

El mecanismo de la stable diffusion

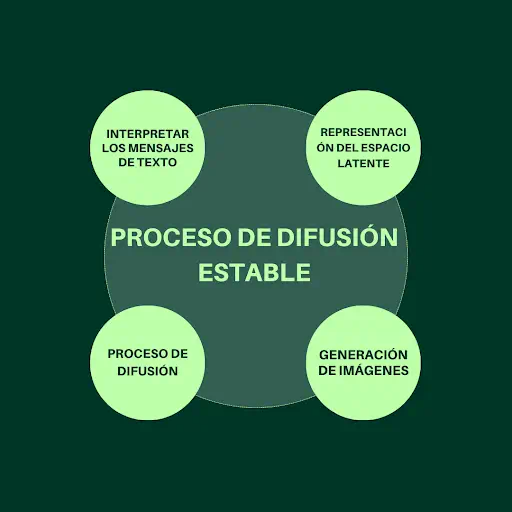

El mecanismo que subyace a la stable diffusion es un proceso de varios pasos que transforma un mensaje de texto proporcionado por el usuario en la imagen correspondiente con precisión y claridad.

En primer lugar, la IA interpreta el texto del usuario e identifica los temas y componentes esenciales que deben representarse visualmente.

A continuación, el texto se transforma y se comprime en una representación abstracta de datos, un espacio latente facilitado por un autoencoder variacional. A continuación, comienza el proceso de difusión, que introduce progresivamente ruido en la representación latente y lo elimina sistemáticamente a lo largo de una serie de iteraciones.

Por último, en la fase de generación de imágenes, el modelo elimina el ruido de la representación latente al tiempo que se adhiere al texto inicial, produciendo una imagen final que coincide fielmente con la descripción proporcionada.

Este intrincado proceso garantiza que las imágenes resultantes mantengan la estabilidad y la precisión a lo largo de su creación, dando vida visualmente a conceptos basados en texto.

Cómo interviene la stable diffusion en la creación de imágenes?

La stable diffusion es un revolucionario modelo de difusión para la producción de imágenes que se distingue por codificar las imágenes en un espacio latente de definición reducida en lugar de en el espacio de píxeles mediante ruido gaussiano.

Este método utiliza de forma efectiva una huella de datos significativamente reducida, lo que permite su ejecución en las GPU de consumo habituales.

El modelo utiliza un autoencoder variacional para afinar los detalles de las fotos que genera y se entrena con conjuntos de datos de LAION centrados en imágenes de gran belleza. No requiere mucha potencia de cálculo para su uso en ordenadores de sobremesa gracias a su eficaz procesamiento.

Software para utilizar la stable diffusion

La gente puede utilizar la stable diffusion a través de una variedad de opciones. Puede ejecutarlo en su ordenador, integrarlo con Leap AI para modelos personalizados o utilizar plataformas como NightCafe para acceder a la API. Stability AI ofrece algunas opciones fáciles de usar:

- Hugging Face

- ClipDrop

- DreamStudio

Estas plataformas proporcionan una amplia gama de métodos para utilizar las capacidades de Stable Diffusion. DreamStudio te da un mayor control sobre la creación de imágenes, pero Clipdrop es más simple y casi accesible. Ambas son bastante fáciles de usar, lo que las convierte en grandes opciones para aprender sobre las posibilidades de la difusión estable.

Se recomienda el código de GitHub para Stable Diffusion para aquellos que prefieran una configuración local o utilizar Google Colaboratory.

Hugging Face

Hugging Face es una plataforma web que ofrece acceso a varios modelos de IA, incluido Stable Diffusion. Gracias a su conocida y sencilla interfaz, es una opción popular para cualquiera que desee jugar con la IA sin necesidad de un alto nivel de conocimientos técnicos.

Hugging Face ofrece versiones premium y gratuitas para satisfacer las demandas de distintos usuarios.

Mientras que la versión de suscripción suele ofrecer funciones más excelentes y límites de uso más elevados, lo que la hace apropiada para aplicaciones más intensivas o comerciales, la versión gratuita permite a los usuarios acceder a varios modelos con restricciones de uso limitadas.

Puede introducir sus datos para generar imágenes utilizando la Difusión Estable, como en la imagen de abajo, y hacer clic en «Generar».

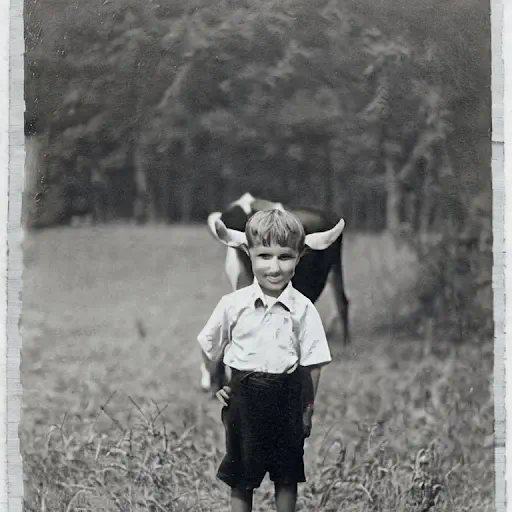

En Cara Abrazada, cuando usas stable diffusion con tu mensaje de texto, se te presentan múltiples opciones de imagen generadas por la IA.

Esta variedad te permite seleccionar la imagen que mejor se adapte a tu visión o preferencia. Es una característica beneficiosa, especialmente para proyectos creativos en los que tener opciones puede llevar a resultados más refinados o adecuados.

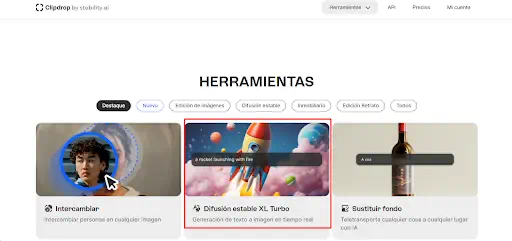

ClipDrop

Clipdrop es una valiosa herramienta para utilizar stable diffusion en la generación de imágenes.

Es una interfaz de usuario sencilla que facilita el trabajo con Stable Diffusion. Los usuarios pueden acceder rápidamente a las funciones de creación y edición de imágenes de Stable Diffusion utilizando Clipdrop.

La facilidad de uso y la accesibilidad de Stable Diffusion mejoran con esta integración, haciéndolo más accesible para cualquiera que desee utilizar la tecnología AI para crear y modificar imágenes.

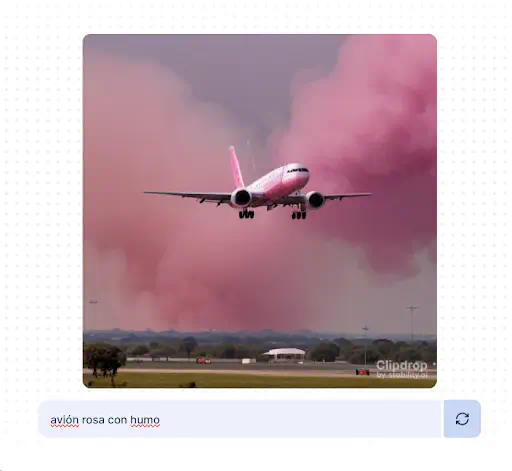

Una vez que haya creado su mensaje único, el siguiente paso es introducirlo en el cuadro de mensajes de ClipDrop. El cuadro es su línea directa de comunicación con la IA, traduciendo sus palabras en arte visual.

Para utilizar Clipdrop con stable diffusion avanzada, es importante tener en cuenta que puede ser necesaria una versión Pro.

La versión Pro de Clipdrop probablemente ofrece características y beneficios adicionales que mejoran la experiencia de generación y edición de imágenes.

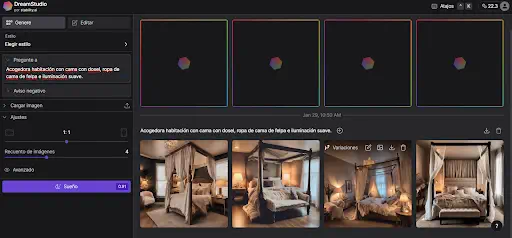

DreamStudio

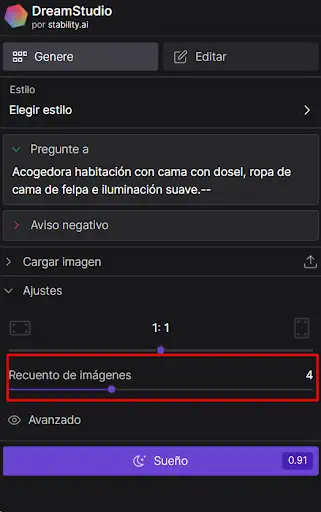

DreamStudio es una potente e innovadora suite de software diseñada para dotar a artistas, diseñadores y profesionales creativos de las herramientas que necesitan para convertir sus sueños en asombrosas realidades visuales, todo ello aprovechando el poder de la difusión estable.

Tras iniciar sesión o registrarse, accederá a una página en la que podrá expresar sus ideas.

Dream Studio es más que una herramienta: es un portal a la creatividad visual que permite a los usuarios dar vida a sus ideas de forma precisa y sorprendente.

Gracias a sus avanzados algoritmos de IA, Dream Studio puede generar imágenes con un nivel de detalle y una riqueza artística impresionantes.

También tiene la flexibilidad de modificar el número de imágenes para adaptarlo a sus necesidades específicas.

Por ejemplo, si tu proyecto requiere una representación visual más completa, puedes optar por tres imágenes o más, en función de la complejidad y profundidad del contenido en el que estés trabajando

El viaje de desarrollo de la stable diffusion

Dos fases importantes en el desarrollo de la síntesis texto-imagen han sido esenciales para obtener los fantásticos resultados actuales. Mientras que los primeros modelos generativos, como los GAN y los VAE, conseguían producir imágenes, tenían menos éxito a la hora de crear imágenes concretas a partir de descripciones textuales.

El énfasis en la estabilidad y la claridad, tal y como se aprecia en los desarrollos de las metodologías de entrenamiento, las funciones de pérdida y la integración de VAE, condujo al gran avance.

Seguir estos procedimientos garantizaba que las imágenes producidas conservaran su precisión y atractivo estético y coincidieran con las instrucciones escritas.

El viaje demuestra la continua búsqueda de la excelencia en la generación de imágenes basada en IA, que en última instancia conduce a la notable capacidad de Stable Diffusion para producir imágenes excelentes a partir de texto.

Progreso de la stable diffusion a lo largo de los años

La evolución de stable diffusion no sólo ha estado marcada por los avances técnicos, sino también por la financiación y la colaboración estratégicas. Stability AI, una empresa emergente con visión de futuro y crucial para el desarrollo del modelo, inició y financió el proyecto.

El grupo CompVis de la Universidad Ludwig Maximilian de Múnich proporcionó generosamente licencias técnicas para el modelo, facilitando así la investigación y la innovación.

Patrick Esser, de Runway, y Robin Rombach, de CompVis, contribuyeron decisivamente a inventar la arquitectura del modelo de difusión latente de Stable Diffusion. Su experiencia contribuyó significativamente a la precisión y estabilidad del modelo.

Además, Stability AI agradeció el apoyo de Eleuthera y LAION, una organización alemana sin ánimo de lucro que reunió el conjunto de datos utilizado para entrenar Stable Diffusion, lo que pone aún más de relieve la naturaleza colaborativa del esfuerzo.

En un hito significativo, Stability AI recaudó una impresionante financiación de 101 millones de dólares en octubre de 2022, con Lightspeed Venture Partners y Coatue Management liderando la ronda de financiación.

Esta inversión sustancial subrayó el reconocimiento de la industria del potencial del modelo y la importancia de Stable Diffusion en la síntesis creativa impulsada por IA.

En conjunto, estos elementos dieron forma a la trayectoria de desarrollo de Stable Diffusion, culminando en su posición como solución de vanguardia para generar imágenes de alta calidad a partir de indicaciones de texto.

Dónde puede utilizarse stable diffusion?

Stable Diffusion tiene una amplia gama de aplicaciones en diversos sectores gracias a su extraordinaria capacidad de síntesis de texto a imagen. Esta moderna tecnología permite a los profesionales creativos del marketing, el comercio electrónico, el entretenimiento y el arte y el diseño convertir conceptos escritos en gráficos visualmente atractivos.

Es esencial para el sector del entretenimiento, ya que crea arte conceptual para películas y videojuegos y ayuda a los anunciantes a crear anuncios visualmente atractivos.

También crea automáticamente fotos de productos a partir de descripciones de texto, lo que simplifica las operaciones de comercio electrónico.

Su stable diffusion mejora la comunicación, la visualización y la expresión creativa en diversos campos, como la investigación, la educación, la arquitectura, la moda y el diseño de interfaces de usuario. Gracias a su adaptabilidad, puede utilizarse para mejorar los aspectos visuales de diversos proyectos y actividades creativas.

Comparación entre Stable Diffusion y DALLE

Dos innovadores sistemas de IA diseñados para crear imágenes son Stable Diffusion y DALLE de OpenAI, aunque tienen ventajas y métodos diferentes. Para los artistas y diseñadores que exigen realidad y precisión en sus visuales, la stable diffusion está especializada en convertir descripciones escritas en representaciones visualmente precisas.

Por el contrario, DALLE libera su potencial creativo produciendo imágenes que responden a señales textuales, combinando texto e imágenes para crear contenidos innovadores y cognitivos.

La stable diffusion es excelente para las representaciones precisas, pero DALLE explora un espacio creativo más amplio, proporcionando a escritores, narradores y pensadores creativos una combinación de texto y conceptos visuales.

La elección entre ambos depende de si el usuario busca precisión y contenidos visuales o desea explorar los límites de la creatividad conceptual enriquecida por la IA.

Existen posibilidades de formación en stable diffusion?

Para aquellos que quieran aprender más sobre la stable diffusion y la inteligencia artificial en general, hay muchas opciones educativas y de formación disponibles. En cursos en línea como Coursera, edX y Udacity se ofrecen planes de estudios completos sobre inteligencia artificial, aprendizaje profundo y visión por ordenador. Estos temas son esenciales para comprender la stable diffusion.

Los títulos de posgrado en IA también están disponibles en universidades de todo el mundo, dando a las personas que persiguen la educación formal acceso a información en profundidad y oportunidades de investigación. Instituciones de investigación como OpenAI publican valiosos artículos y documentación relacionados con la stable diffusion.

El desarrollo de habilidades prácticas también puede facilitarse mediante el aprendizaje autodidacta a través de tutoriales, grupos en línea y eventos de hacking o competiciones de IA. Obtener un certificado en IA, asistir a conferencias sobre IA y estudiar programas especializados en IA completan una amplia gama de opciones educativas.

La elección depende de los objetivos individuales, ya sea el aprendizaje básico, los esfuerzos de investigación o la experiencia centrada en la aplicación, todos ellos esenciales para aprovechar eficazmente el potencial de las tecnologías de IA como la stable diffusion.

Consideraciones éticas en el uso de la stable diffusion

La stable diffusion y las tecnologías de IA relacionadas deben utilizarse de forma ética. Plantean varias cuestiones éticas críticas cuando se aplican, sobre todo al producir contenidos creativos.

Entre ellas se encuentran la posibilidad de obtener resultados sesgados que reflejen prejuicios sociales, la necesidad de obtener el consentimiento informado cuando participen personas y la protección contra la creación de deepfakes engañosos.

Mantener los derechos de propiedad intelectual y la integridad artística también exige abordar los problemas de derechos de autor, plagio y atribución correcta. Los principales problemas también incluyen la responsabilidad de seguir normas éticas, la prevención de resultados inapropiados o perjudiciales y la transparencia a la hora de etiquetar los contenidos generados por IA.

Las preocupaciones a largo plazo se centran en cómo afectan los contenidos generados por IA a la producción artística y creativa humana. Las tecnologías de stable diffusion y de IA deben utilizarse de forma responsable y diligente para sortear estas complejidades éticas.

Esto requiere marcos éticos permanentes, regulación y el compromiso de fomentar la colaboración entre los creadores humanos y los sistemas de IA para capitalizar sus puntos fuertes respetando los límites morales.

El futuro de la stable diffusion

La stable diffusion tiene el potencial de transformar la innovación en varios campos en el futuro. La capacidad de la difusión estable para producir imágenes increíblemente realistas seguirá ampliando los límites del arte y el diseño digitales a medida que avancen las tecnologías de IA.

Además, se espera la integración de muchas formas creativas, lo que permitirá a la IA combinar hábilmente texto, música y gráficos para crear experiencias de contenidos envolventes. El desarrollo de modelos de IA más inclusivos sigue siendo un objetivo prioritario, centrado en la equidad y los prejuicios.

La colaboración en tiempo real y la producción de contenidos dinámicos serán posibles gracias a una mayor interactividad. La personalización será esencial para garantizar que las imágenes reflejen las preferencias individuales. Las colaboraciones entre humanos e IA darán lugar a iniciativas creativas, y las normas éticas y las leyes garantizarán un uso ético de la IA.

En conclusión, el futuro de la stable diffusion pasa por crear una sociedad en la que la tecnología apoye la diversidad, fomente la creatividad humana y funcione dentro de unos límites éticos. No se trata sólo de hacer avanzar la tecnología.

A medida que nos adentramos en esta nueva era, la mezcla de arte, tecnología y ética conducirá sin duda a un mundo más dinámico, diverso y encantador.

Preguntas más frecuentes (FAQs)

Cómo trata Stable Diffusion los problemas relacionados con la parcialidad en las imágenes generadas por IA?

El objetivo de Stable Diffusion es reducir el sesgo utilizando conjuntos de datos de entrenamiento diversos y de alta calidad, pero los usuarios deben permanecer atentos y revisar el contenido generado para garantizar la imparcialidad y la inclusión.

Puede utilizarse Stable Diffusion para el diseño gráfico profesional y la creación de ilustraciones?

Stable Diffusion puede ser una herramienta valiosa para diseñadores gráficos y artistas profesionales. Su capacidad para generar imágenes detalladas y realistas a partir de descripciones de texto puede mejorar el proceso creativo y ahorrar tiempo.

Cuáles son algunas de las posibles consideraciones legales a la hora de utilizar imágenes generadas por IA en proyectos comerciales?

Las consideraciones legales pueden incluir cuestiones de derechos de autor, derechos de propiedad intelectual y la necesidad de formularios de cesión de modelo si las imágenes generadas por IA implican a personas. Es esencial consultar con profesionales del derecho para garantizar el cumplimiento de las leyes pertinentes.

Cómo gestiona Stable Diffusion la generación de imágenes muy específicas o complejas a partir de mensajes de texto?

Aunque Stable Diffusion destaca en la generación de imágenes detalladas, las solicitudes muy específicas o complejas pueden plantear dificultades. Es posible que los usuarios tengan que repetir las instrucciones o utilizar técnicas de posprocesamiento para obtener los resultados deseados.

Existe una comunidad o un foro para que los usuarios de Stable Diffusion compartan experiencias y obtengan ayuda?

Sí, existe una activa comunidad en línea de usuarios y entusiastas de Stable Diffusion que comparten sus experiencias, proporcionan orientación y ofrecen tutoriales. Las plataformas como GitHub, los foros centrados en la IA y las redes sociales son lugares excelentes para conectar con otras personas.